Краткий обзор презентации GBDTE.

Жребий брошен. Я назначил дату презентации по Gradient Boosted Decision Trees - 15 января. Планирую 45 минут, это примерно 30 слайдов. Времени не впритык, но и расслабляться нельзя.

Поэтому я решил остановиться здесь, где нахожусь сейчас, и поработать над презентацией. Текущая точка:

🌳есть эффективная многопоточная реализация на Go с Python-мостом

🌳есть синтетический набор данных MSE

🌳есть синтетический набор данных LogLoss

датасеты показывают, что модель работает и тянет сотни тысяч записей.

Немного о работах-предшественниках:

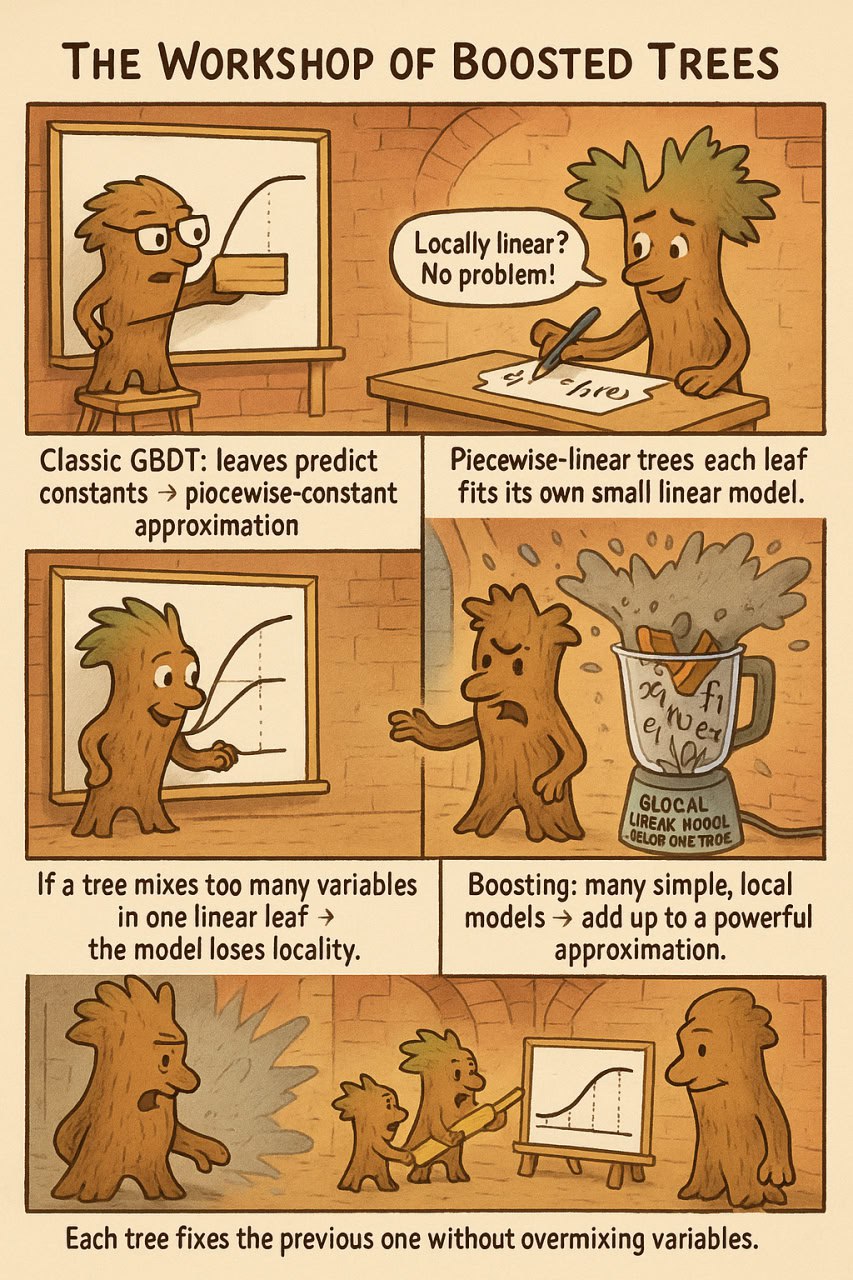

🌳2017 LinXGBoost: расширение XGBoost для обобщенных локальных линейных моделей arXiv

🌳2019 Gradient Boosting with Piece-Wise Linear Regression Trees (GBDT-PL) - IJCAI, paper

🌳2023 Fast Linear Model Trees by PILOT, arXiv

🌳2024 PINE / PINEBoost: Efficient Piecewise-Linear Trees for Gradient Boosting, paper

Я начал о них думать из-за одного интересного момента. В ряде работ авторы пытаются смешивать экстраполяционные и интерполяционные признаки. На мой взгляд, это плохая идея: ломается базовый принцип метода - одним типом признаков группируем объекты, другим ловим тренды.

Мой непреднамеренный эксперимент показал, что качество при таком смешивании падает. И, кажется, я уже понимаю почему.